Exo Life Finder (ELF)

La Nuova Frontiera dell’interferometria ottica e la sfida della tensegrità

Il sogno visionario di Jeff Kuhn

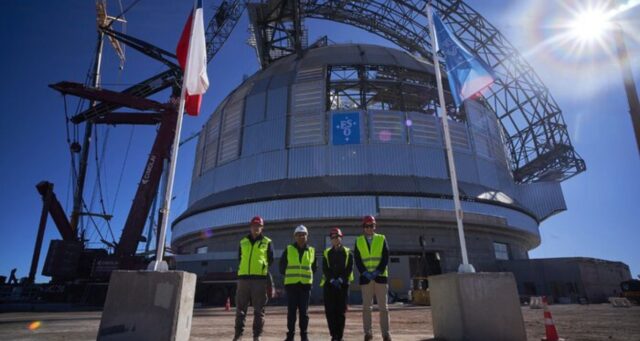

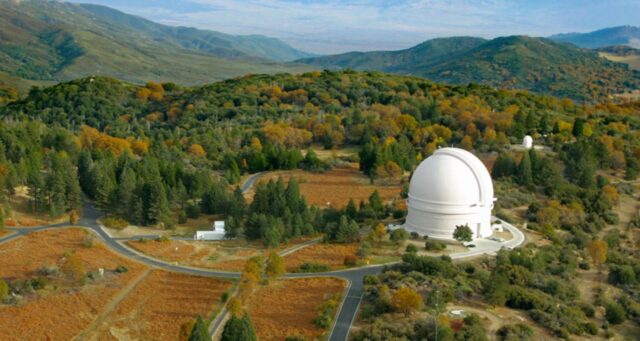

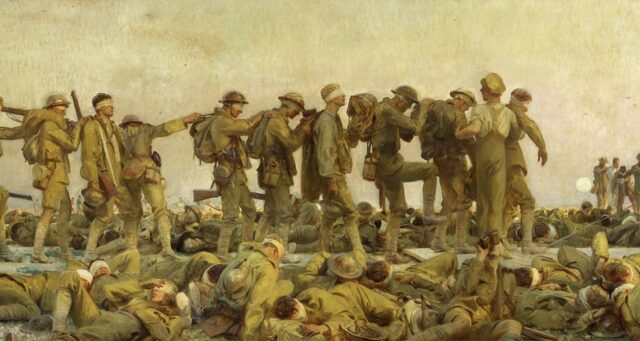

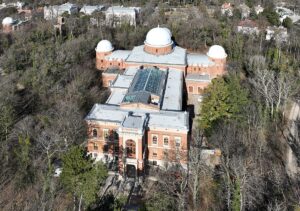

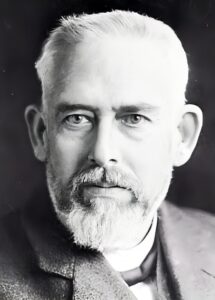

“Dal silenzio al contatto”: è questo il titolo dell’evento organizzato lo scorso 7-8 febbraio dall’Instituto de Astrofísica de Canarias (IAC) a Tenerife, dove si incrociano le traiettorie di scienziati visionari, appassionati di esoplanetologia e giovani ricercatori. È qui che incontriamo Jeff Kuhn, mente carismatica dietro il progetto Exo Life Finder (ELF), che si ripropone niente meno che di trovare prove osservative della presenza della vita al di fuori del nostro pianeta. I suoi capelli grigi arruffati, lo sguardo curioso e la comunicazione trascinante lo rendono una sorta di “rockstar” nel mondo della ricerca astronomica. Nella sede dell’IACtec a Tenerife, Kuhn raduna attorno a sé studenti e giovani talenti, tutti galvanizzati dalla prospettiva di partecipare a uno dei progetti più coraggiosi dell’astrobiologia contemporanea: un telescopio interferometrico da 30-40 metri di diametro capace di mappare e studiare mondi potenzialmente abitabili al di fuori del Sistema Solare.

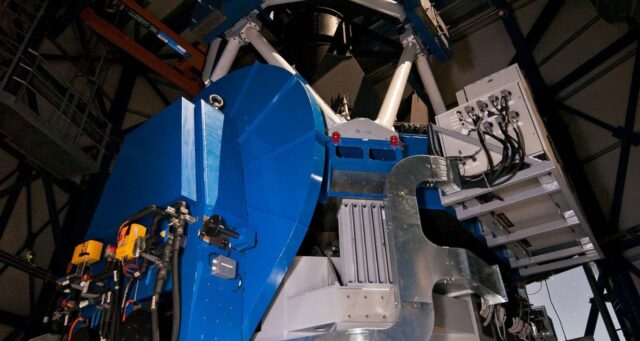

Il LIOM (Laboratorio de Innovacion Opto-Mecanica) è nato proprio per continuare a dare all’IAC un ruolo da protagonista nell’innovazione dei telescopi della prossima generazione. Ci diamo appuntamento all’inizio della settimana seguente per discutere con lui e con il suo team delle peculiarità del progetto ELF. L’edificio che ospita il LIOM, lo IACtec, è nuovo di zecca e sorge in un parco a poca distanza dalla sede principale dell’IAC e dal Museo de la Ciencia y del Cosmos che ha ospitato l’evento.

Kuhn è un brillante esempio di una creatività multidisciplinare. L’idea dell’Exo Life Finder trova un suo predecessore nell’utopica idea di realizzare un telescopio colossale, idealmente dell’apertura di una cinquantina di metri (o oltre) da costruire per ricercare le firme della vita nei pianeti extrasolari. Questo “Colossus”, come venne definito, era però un’idea ben oltre la fattibilità, dato che avrebbe avuto un costo di costruzione di un miliardo di dollari. La PLANETS Foundations, di cui Jeff Kuhn fa parte, ha proprio lo scopo di innovare la tecnologia di osservazione dei pianeti lontani in modo da affrontare in maniera scientifica la ricerca della vita. Sul sito della PLANETS Foundations, infatti, si legge chiaramente che l’obiettivo è quello di creare tecnologie sufficientemente sensibili da riuscire a vedere i continenti sul pianeta che orbita attorno alla stella Proxima Centauri b, che secondo alcuni risultati recenti, (vedi Coelum.com “Segnali di abitabilità su pianeti extrasolari” del 23 marzo 2025 ) potrebbe ospitare acqua liquida. Jeff Kuhn, assieme ad un’altra scienziata dell’Università delle Hawaii, Svetlana Berdyugina, ha scritto vari articoli sulla firma termodinamica che lascerebbero i grandi insediamenti urbani ed industriali su pianeti lontani, segno inequivocabile di una civiltà intelligente (vedasi per esempio l’articolo “Global warming as a detectable thermodynamic marker of Earth-like extrasolar civilizations: The Colossus project”, Svetlana V. Berdyugina, Jeff R. Kuhn, 2015).

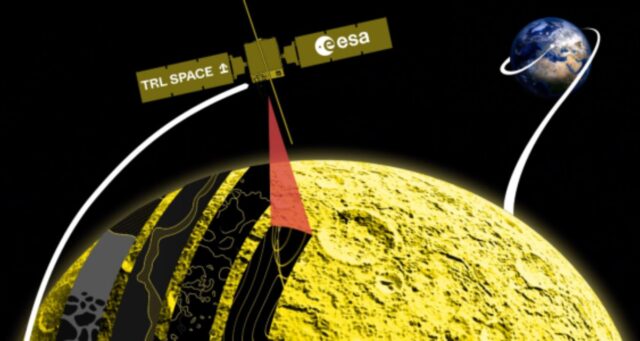

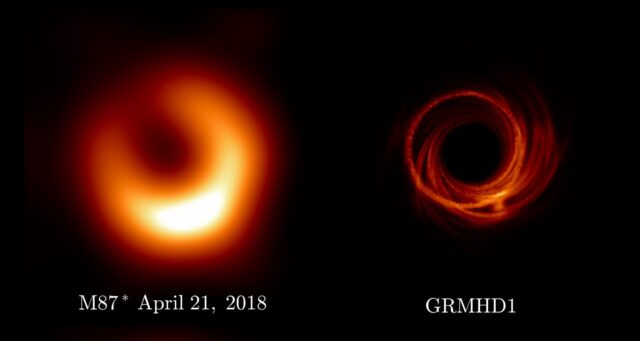

Dalla sua formazione come fisico solare, Kuhn è oggi passato a ideare e coordinare ELF, un telescopio rivoluzionario che ambisce a “cancellare” la luce delle stelle, proprio come le moderne cuffie che eliminano il rumore di fondo, per svelare la luminosità debolissima dei pianeti orbitanti. Tutti conosciamo bene l’interferenza distruttiva nella nostra vita quotidiana, anche se di solito non la definiamo con questo termine tecnico. Nel contesto della musica, la noise cancellation è ormai familiare: un microfono cattura il rumore ambientale e un processore elettronico genera un’onda uguale e contraria, cancellandone gli effetti all’interno dei nostri auricolari, permettendoci di ascoltare la musica anche circondati dal rumore del traffico. ELF intende portare lo stesso concetto in astronomia, ma a una scala infinitamente più raffinata: si parla in questo caso di “Nulling Fizeau Interferometry”. Le stelle sono sorgenti di luce fortissime, la cui luminosità può essere fino a 109 volte superiore a quella dei pianeti che orbitano al loro interno. Per “vedere” il segnale riflesso da un piccolo pianeta roccioso in zona abitabile, è dunque indispensabile sviluppare un meccanismo capace di annullare la luce della stella, esaltando la flebile emissione planetaria. La parola chiave è il “cophasing” dei vari specchi, che devono agire come se fosse una superficie specchiante monolitica con un segnale caratterizzato da un fronte d’onda unico e omogeneo.

Ottica di precisione e onde in conflitto

l’ARTICOLO COMPLETO è riservato agli abbonati alla versione digitale. Per sottoscrivere l’abbonamento Clicca qui. Se sei già abbonato accedi al tuo account dall’Area Riservata

[swpm_protected for=”3″]

Kuhn e il suo team, che contano con grandi esperti come Maud Langlois del CNRS francese e dell’Università di Lione, Edward Kibblewhite dell’Università di Chicago o Gil Moretto, membro del CNRS anch’egli, puntano sull’interferometria, una tecnica che sfrutta il carattere ondulatorio della luce. Se un picco di un’onda coincide con il picco di un’altra onda simile, il segnale risultante si amplifica; se un picco incontra un minimo, invece, si crea un annullamento parziale o totale. Nel caso di ELF, l’obiettivo è realizzare una configurazione che produca l’interferenza distruttiva della luce della stella lasciando inalterata quella del pianeta: per questo si definisce “nulling interferometry”. È un concetto semplice da enunciare, ma estremamente complesso da realizzare, poiché richiede un controllo precisissimo (nell’ordine dei nanometri) di ogni elemento ottico coinvolto.

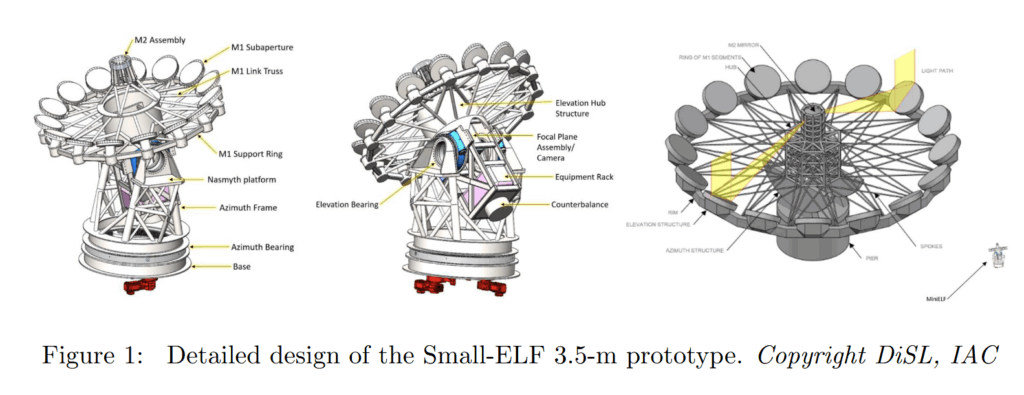

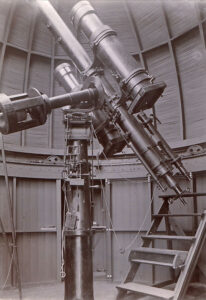

La struttura è sostanzialmente un’evoluzione di quella ben nota di un telescopio gregoriano: l’immagine sarà raccolta da una serie di specchi disposti a raggiera e quindi convogliata verso uno specchio secondario centrale, dotato di un sistema di ottica adattiva e concepito per correggere le imperfezioni del segnale dovute alle turbolenze dell’atmosfera terrestre. Il segnale in seguito verrà inviato verso il sistema elettronico di raccolta delle immagini. Si tratterà di emissioni estremamente deboli, dell’ordine di pochi fotoni, da cui occorrerà estrarre quante più informazioni possibile. Riuscire a realizzare interferometria con sorgenti dal diametro angolare così ridotto (e con un flusso composto da pochi fotoni!) è una sfida senza precedenti per l’astronomia osservativa. Auxiliadora Padron, ci illustra come si pensa di riuscire nell’impresa di realizzare “cophasing” e interferenza distruttiva (il “nulling”) sulla luce della stella centrale. Auxiliadora è poco più che trentenne, ha studiato ottica quantistica a Barcellona ma è originaria La Orotava, a circa trentacinque chilometri dalla sede dell’IACtec.

Ogni tanto i cervelli riescono a tornare a casa, se le istituzioni puntano sulla ricerca di alto livello.

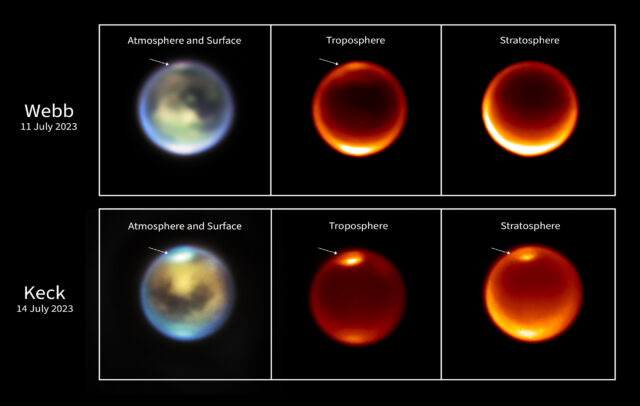

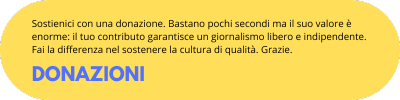

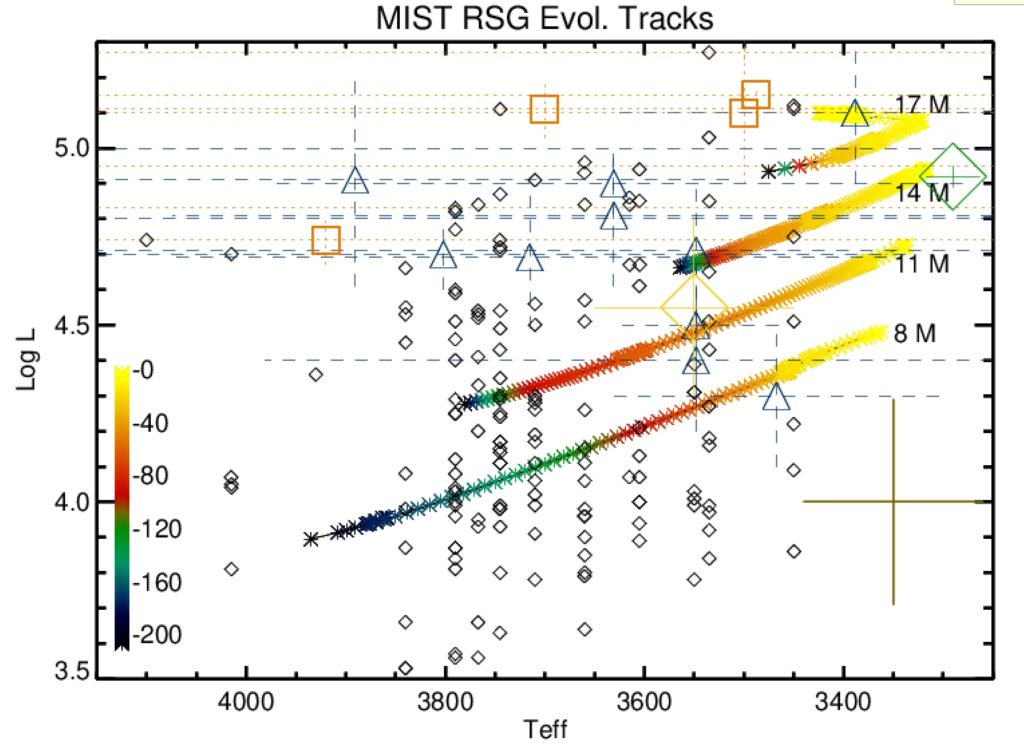

Finora, la maggior parte delle informazioni sugli esopianeti è stata raccolta tramite metodi indiretti, come la spettroscopia di velocità radiale o il transito. Approcci hanno prodotto risultati straordinari, ma che si rivelano ottimali soprattutto per pianeti giganti, oppure per sistemi allineati in modo fortunato. Per individuare pianeti rocciosi di piccola massa, orbitanti in zone abitabili, occorre un salto di qualità. E l’interferometria distruttiva della luce stellare potrebbe offrire la svolta desiderata, permettendo di vedere direttamente un pianeta la cui luminosità è fino a 109 volte più debole di quella della stella ospite, ossia una capacità di risoluzione dell’immagine con un contrasto di una parte su un miliardo. Un bel salto qualitativo, se pensiamo che attualmente i più avanzati telescopi terrestri raggiungono un contrasto di una parte su dieci milioni!

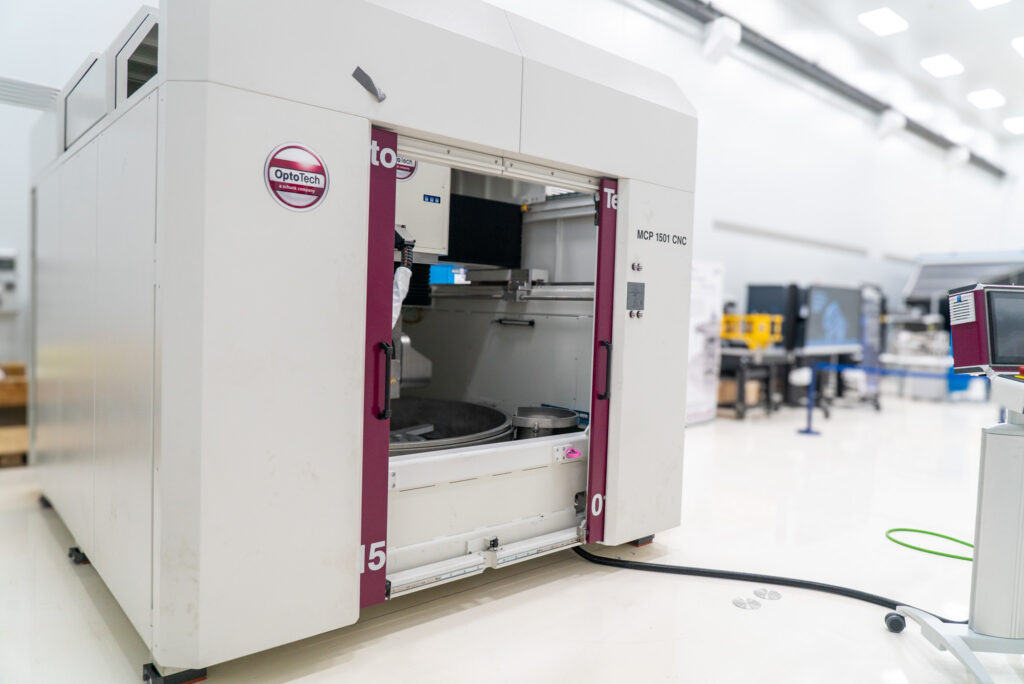

L’idea su cui stanno lavorando i tecnici attualmente si basa su degli specchi ultraleggeri e correttivi a densità ridotta la cui la superficie specchiante sarà raggiunta con tecniche di stampa 3D additiva e non abrasiva: in sostanza verranno spruzzate delicatamente degli strati riflettenti in maniera perfettamente omogenea. Visitiamo i 200 metri quadrati del laboratorio LIOM all’interno del IACtec, inaugurato nel 2020, assieme al giovane ricercatore canario Alejandro Ruiz Sabina, che ci accompagna e ci spiega con estrema chiarezza le sfide del progetto ELF dal punto di vista dei sistemi ottici. I macchinari a disposizione del LIOM, come la macchina pulitrice Optotech MCP 1501 CNC, sono dei pezzi quasi unici, che si contano sulle dita di una mano in tutto il mondo, e non è un’esagerazione. Per la deformazione ottica delle lenti viene adottata una tecnica avanzata, ideata dalla startup MorphOptic, che prevede di riscaldare con fasci laser alcuni punti specifici della superficie, calcolate con estrema precisione, che prende il nome di “curvature polishing”, invece del tradizionale “fire polishing”. L’effetto è quello di creare un gradiente termico che possa curvare la lente con una pulizia ed una trasparenza impossibile da ottenere con i metodi tradizionali. Per incidere le lenti, si usano macchine industriali con laser a CO2 di marca OMtech di estrema potenza e precisione. In tal modo, l’elemento ottico — riscaldato soltanto su un lato — subisce una leggera e controllata curvatura. Tutto ciò richiede un’ingegneria di altissimo livello: ogni passaggio è progettato per garantire una qualità di realizzazione e un’innovazione senza precedenti.

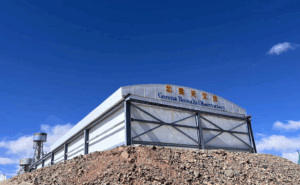

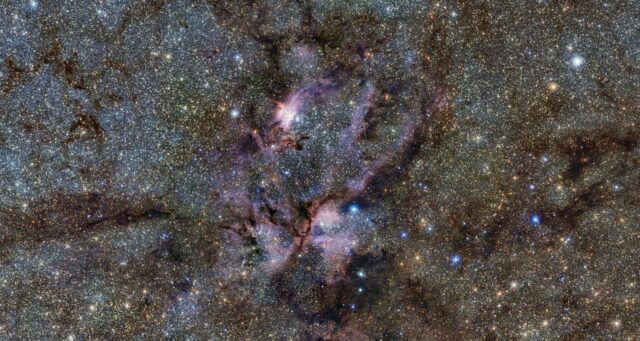

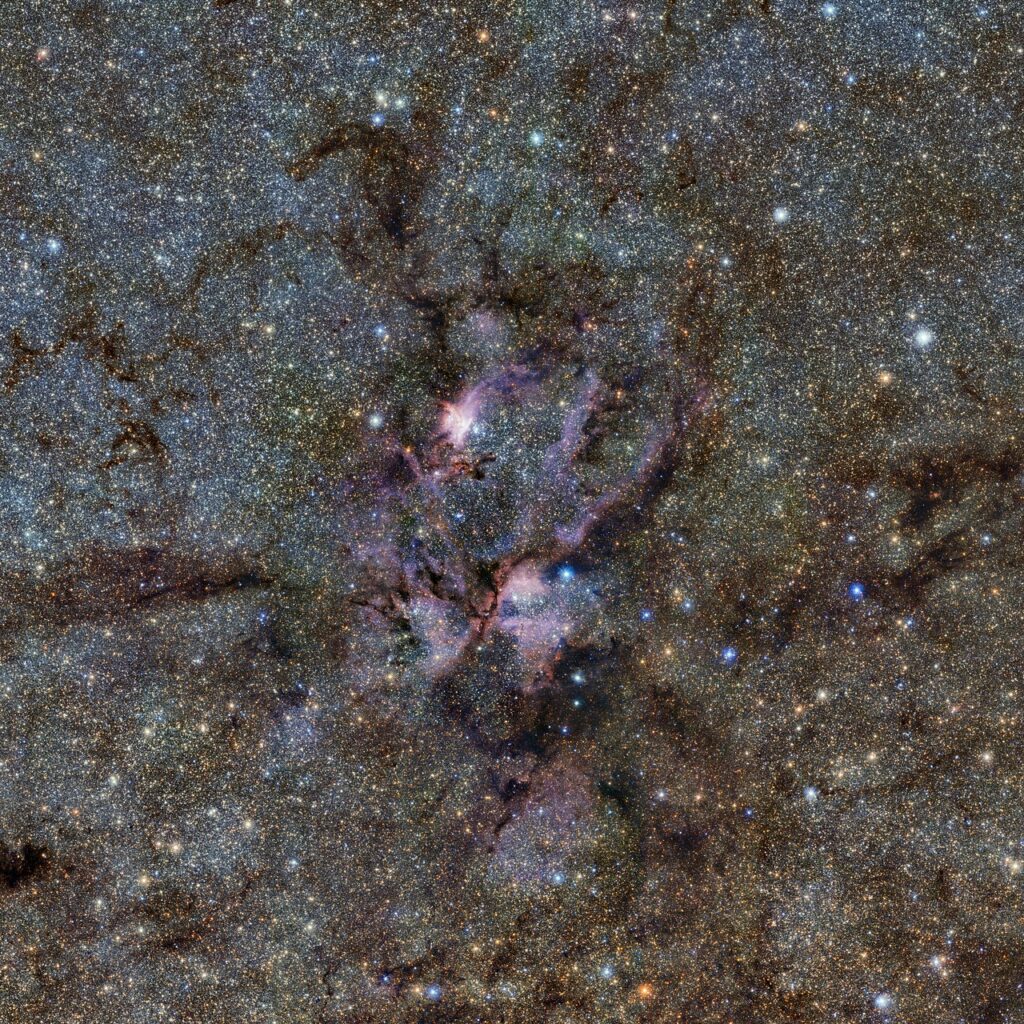

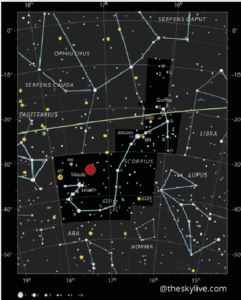

Per testare l’idea, Kuhn e colleghi stanno costruendo un prototipo ridotto, battezzato Small-ELF (SELF), il cui capo progetto scientifico è il ricercatore francese Nicolas Lodieu. Con un diametro di 3,5 m e 15 segmenti speculari da 50 cm cadauno disposti “a fiore”, SELF sorgerà sul vulcano Teide a Tenerife, con l’obiettivo di tentare l’osservazione di Proxima Centauri b, uno dei mondi più prossimi a noi e potenzialmente abitabile. Se il prototipo riuscirà anche solo a captare un barlume di segnali riflessi dal pianeta, si sarà trattato di un successo straordinario. Gli scienziati contano di analizzare le linee spettrali, alla ricerca di molecole come l’anidride carbonica, l’ossigeno, il metano, possibili tracce di fotosintesi o di attività biologiche analoghe a quelle terrestri.

Tensegrità e architettura spinta

Una volta validato il modello con SELF, si passerà alla realizzazione di Exo Life Finder in scala completa, con un diametro di 35 m composto da 15 specchi, ciascuno di 5 m di diametro. La potenza di raccolta di luce e la capacità interferometrica di un tale sistema consentiranno di studiare molti sistemi stellari vicini e, chissà, di identificare anche segnali artificiali (la cosiddetta “impronta industriale”) qualora esistessero civiltà avanzate su altri mondi.

La grande sfida di ELF non è solo ottica, ma anche ingegneristica ed economica. Costruire un sistema di 16 specchi giganteschi e un sistema di bracci interferometrici è un’impresa che potrebbe costare ben oltre un miliardo di dollari, date le complessità strutturali e i materiali da impiegare. Ed è qui che entra in gioco la tensegrità: una concezione architettonica e ingegneristica basata sull’impiego di elementi in tensione e compressione in una configurazione autoportante. Questa tecnica, resa celebre da figure visionarie come l’architetto Richard Buckminster Fuller, permette di ottenere costruzioni sorprendentemente leggere e rigide al tempo stesso. L’etimologia del termine fa riferimento alla “tensione” e all’”integrità” (o coesione) delle strutture così concepite. Un esempio molto famoso di struttura in tensegrità è la cupola geodetica della Serra di Montreal, in Canada, concepita dallo stesso Buckminster Fuller per l’Expo del 1967. Brevettate nel 1954, in Italia troviamo una piccola scultura dello stesso artista a Spoleto (la struttura nota come “Spoletosfera”), donata alla città nel 1967 per la decima edizione del Festival dei Due Mondi.

La tensegrità sfrutta la separazione tra componenti compressivi (i “struts”, di solito barre rigide) ed elementi flessibili in tensione (cavi ad alta resistenza). In una struttura ben progettata, ogni forza di compressione è compensata dalle tensioni distribuite nei cavi, ottenendo così un equilibrio dinamico che assicura stabilità e leggerezza. Nel contesto di ELF, l’idea è quella di sostenere e allineare i vari segmenti speculari con un sistema di travi e cavi in tensione, riducendo drasticamente la necessità di massicci supporti in acciaio o altri metalli pesanti.

Se non si applicasse la tensegrità, la costruzione di un telescopio di 30-40 metri di diametro si tradurrebbe in una struttura dal peso esorbitante, con costi logistici e di fabbricazione alle stelle. Invece, la prospettiva di Kuhn e del suo team è di impiegare materiali compositi ultraleggeri, combinati con cavi e barre disposti in modo da sostenere gli specchi e mantenerli correttamente allineati. Così facendo, le stime iniziali di un miliardo di dollari per ELF potrebbero ridursi a un decimo del costo previsto per la struttura costruita con tecniche tradizionali, con un telescopio in tensegrità i costi si scenderebbero fino a 200 o persino 100 milioni di euro – una soglia pur sempre importante, ma nettamente più gestibile e plausibile per un consorzio internazionale di istituti e finanziatori.

È chiaro che un sistema di cavi e struts, per quanto leggero, dev’essere accuratamente progettato per resistere a venti forti, variazioni termiche, vibrazioni sismiche e altri fattori ambientali. Ogni cavo ha una tensione misurata e calibrata, e la struttura nel suo complesso lavora in modo da distribuire uniformemente le sollecitazioni. Inoltre, l’uso di sensori e attuatori intelligenti consente un feedback continuo, così da regolare la tensione dei cavi qualora le condizioni esterne cambino. In questo modo, anche in piena notte, la stabilità ottica necessaria per generare interferenze distruttive della luce stellare è preservata.

Anche se sono ormai numerose le strutture architettoniche concepite seguendo i dettami della tensegrità (vedasi ad esempio il Kurlipa Bridge, a Brisbane, nel Queensland, Australia), la sua applicazione nel contesto astrofisico è rivoluzionaria: combinare l’ottica di precisione con un impianto di cavi in tensione richiede un livello di calcolo e progettazione senza precedenti. Se l’esperimento avrà successo potrà aprire la strada a una nuova generazione di telescopi terrestri, estendendo l’applicazione della tensegrità ben oltre i confini immaginati finora.

Ottica e struttura nel cuore di ELF

La struttura degli specchi e le sfide ingegneristiche ci vengono spiegate da Patricia Fernandez Izquierdo, un’ingegnera strutturale che si sta occupando della progettazione del complesso. I pezzi sono numerosissimi e ognuno deve essere ideato con la massima precisione, senza alcuna possibilità d’errore. Patricia è canaria ed ha studiato all’Università di Siviglia, in Andalusia. La possibilità di realizzare un progetto così avanzato nel suo arcipelago è per la giovane ricercatrice un’opportunità straordinaria. Oltre alla parte ingegneristica, Patricia si dedica alla parte di criogenizzazione che deve accompagnare la raccolta dei segnali elettromagnetici anche in lunghezze d’onda oltre il visibile, come l’infrarosso. Ma perchè tanta attenzione all’infrarosso per l’ELF?

Una delle idee più suggestive emerse dalle conversazioni con Jeff Kuhn riguarda la possibilità di individuare non solo segnali biologici, ma addirittura civiltà extraterrestri industrializzate. Se esistessero megalopoli su un pianeta orbitante attorno a una stella vicina, la loro attività potrebbe generare un eccesso di anidride carbonica o di altre molecole tipiche dei processi industriali (un po’ come la nostra Terra). In teoria, un telescopio come ELF, dotato di interferometria distruttiva e di un’eccezionale risoluzione spettrale, potrebbe rilevare queste “impronte” artificiali.

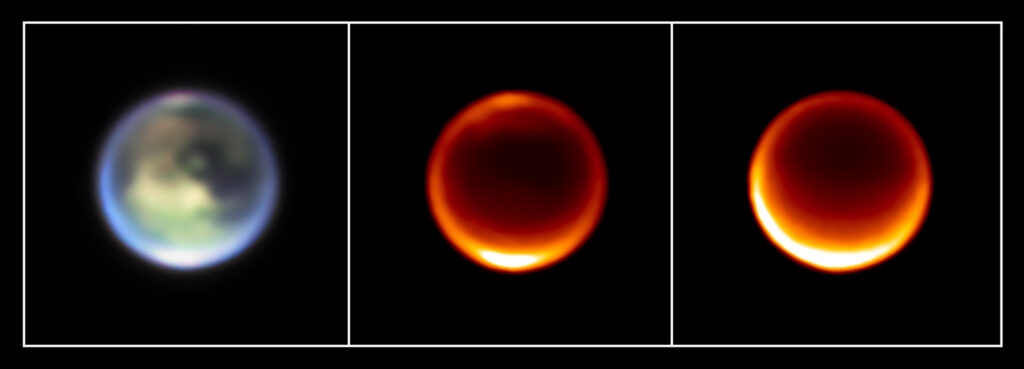

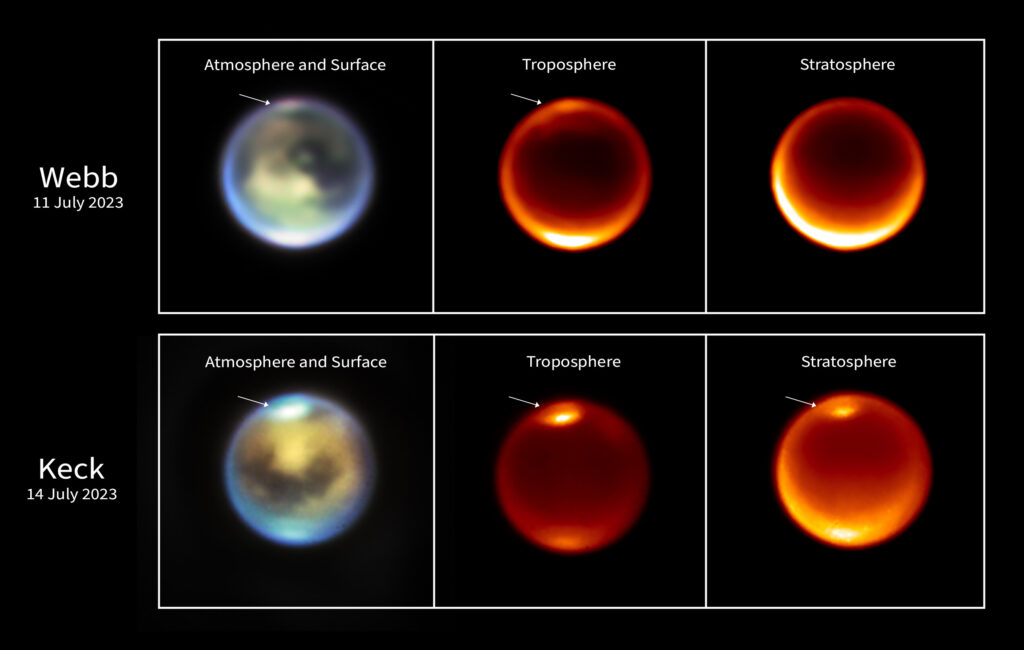

Nella storia del nostro Sistema Solare, i giganti gassosi – come Giove e Saturno – ospitano lune potenzialmente adatte alla vita (si pensi ad Europa, Encelado o Titano). Kuhn ipotizza che, in sistemi stellari lontani, la presenza di satelliti rocciosi attorno a pianeti giganti possa costituire un rifugio ancora più probabile per la vita rispetto ai pianeti orbitanti più vicini. Studiare queste lune richiede però strumenti in grado di discernere dettagli minuti, rendendo ancora più stringente la necessità di un telescopio grande, interferometrico e capace di ridurre i costi come ELF.

In effetti, la luce riflessa del pianeta principale attorno al quale orbita un satellite è un elemento di stabilità termica importante, e l’effetto di marea gravitazionale può indurre una costante frizione degli strati geologici superiori del satellite e pertanto produrre una tettonica dinamica e un costante rinnovamento della superficie del satellite, in maniera non dissimile da quello che accade sulla terra (per ulteriori informazioni in proposito, non possiamo che suggerire di leggere l’articolo “Exomoon habitability constrained by illumination and tidal heating” di Heller e Barnes del 2013).

Conclusioni

Exo Life Finder incarna la perfetta commistione fra ambizione scientifica e innovazione ingegneristica. Da un lato, sfruttare l’interferenza per “cancellare” la luce stellare e dare voce alla flebile emissione dei pianeti è un traguardo che rivoluzionerebbe il nostro approccio all’astrobiologia; dall’altro, l’adozione della tensegrità – unita a specchi segmentati e algoritmi di cophasing estremi – consente di ipotizzare la realizzazione di un telescopio da 35 metri a un costo decisamente inferiore rispetto ai modelli di scala passata, aggirandosi attorno ai 100-200 milioni di euro.

Incontrare Jeff Kuhn nel suo ufficio a Tenerife, fra apparecchiature ottiche sperimentali e un mucchio di giovani ricercatori entusiasti, significa toccare con mano la passione e la determinazione che muovono questa impresa. Se il prototipo Small-ELF (SELF) avrà successo nel 2027, gettando le basi per l’enorme ELF, potremmo in un futuro non troppo distante osservare la superficie di Proxima b, scovare firme biologiche e, chissà, magari anche segni di civiltà evolute (vedasi l’articolo “Surface Imaging of Proxima b and Other Exoplanets: Topography, Biosignatures, and Artificial Mega-Structures”, Svetlana V. Berdyugina, Jeff R. Kuhn, 2017). È la scienza che si fa racconto epico: dall’interferenza che annulla la luce di una stella alla scoperta di mondi potenzialmente abitabili, passando per la magia strutturale della tensegrità che abbatte i costi e ci avvicina al sogno di “vedere” realmente cosa accade su un pianeta lontano. L’obiettivo di ELF è quello di riuscire a vedere la superficie di pianeti lontani anche a trenta anni luce da noi.

Colpisce l’età media all’interno del laboratorio LIOM del IACtec, ben al di sotto dei quarant’anni, e la forte presenza femminile all’interno del progetto ELF: la moltiplicità di vedute di sicuro dota di una robustezza ulteriore il programma. Molti giovani canari che avevano studiato nella Penisola Iberica, a Siviglia o a Barcellona, sono potuti tornare sull’isola per continuare a lavorare nel loro campo.

Il progetto ELF testimonia che l’innovazione non risiede soltanto nel saper fare scienza di eccellenza, ma anche nell’arte di “ingegnerizzare l’impossibile”. E in questa arte, la tensegrità si candida a essere il filo sottile ma tenace su cui si aggrapperanno i sogni della prossima generazione di telescopi. In gioco c’è la speranza di trovare, un giorno, compagnia fra le stelle.

[/swpm_protected]

L’articolo è pubblicato in COELUM 274 VERSIONE CARTACEA

È grazie alla diversità delle proprietà fisiche dei vari universi costituenti il multiverso che siamo in grado di usare il principio antropico per spiegare l’universo in cui viviamo. Partendo dall’idea della diversità delle condizioni all’interno del multiverso, Steven Weinberg e i suoi collaboratori hanno calcolato come mai il nostro cosmo contiene la quantità di energia “proprio giusta” per avere un ambiente capace di accogliere la vita e, in particolare, gli esseri umani. E ci sono anche alcuni aspetti fondamentali della fisica delle particelle, come l’esistenza degli stessi atomi, che non si riescono a spiegare senza invocare le implicazioni antropiche del multiverso, e proprietà del Modello Standard – segnatamente la massa del bosone di Higgs che conferisce massa alle particelle subatomiche – il cui valore risulta strettamente legato al dato osservativo dell’esistenza di forme di vita.

È grazie alla diversità delle proprietà fisiche dei vari universi costituenti il multiverso che siamo in grado di usare il principio antropico per spiegare l’universo in cui viviamo. Partendo dall’idea della diversità delle condizioni all’interno del multiverso, Steven Weinberg e i suoi collaboratori hanno calcolato come mai il nostro cosmo contiene la quantità di energia “proprio giusta” per avere un ambiente capace di accogliere la vita e, in particolare, gli esseri umani. E ci sono anche alcuni aspetti fondamentali della fisica delle particelle, come l’esistenza degli stessi atomi, che non si riescono a spiegare senza invocare le implicazioni antropiche del multiverso, e proprietà del Modello Standard – segnatamente la massa del bosone di Higgs che conferisce massa alle particelle subatomiche – il cui valore risulta strettamente legato al dato osservativo dell’esistenza di forme di vita.