Infinity2 – Il Liceo di Montegiorgio Vola nello Spazio

Le possibili applicazioni dell’anidride carbonica nello spazio e l’alga spirulina futuro cibo degli astronauti.

Dopo Infinity I pubblicato in Coelum Astronomia n°262 arrivano nuove sonde nello spazio per il Liceo Scientifico di Montegiorgio (FM): il progetto “Infinity 2”.

a cura di Antolini Ettore, Braschi Matteo, Staderini Alessandro, Vitali Chiara.

Indice dei contenuti

Introduzione

Dopo “Infinity 1” nuove sonde spaziali realizzate presso il Liceo Scientifico “E.Medi” di Montegiorgio – IISS “ C.Urbani” (FM) – e lanciate nello spazio dall’Islanda.

Un progetto straordinario quello che è stato portato avanti dagli studenti e dalle studentesse del Liceo che, divisi in due team di lavoro, gruppo “base” e gruppo di “missione”, hanno ideato e realizzato i lanci delle sonde, cariche di esperimenti scientifici, nel nord Europa dal 3 al 12 aprile 2024 insieme ai loro docenti. Il Ministero dell’Istruzione e del Merito ha attenzionato fin da subito la rilevanza di questo Progetto presentandolo a Roma.

“Infinity2” ha fatto seguito ad un primo esperimento condotto tra il 2022 ed il 2023, consistente nel lancio in Italia di una sonda con pallone aerostatico per studiare i gas serra e per fare riprese video concernenti la curvatura terrestre. Il credito acquisito da questa esperienza didattica, premiata dall’ASI a Milano durante il Contest 2023 “Verso lo spazio con Samantha” direttamente dall’astronauta Samanta Cristoforetti, ha incoraggiato i docenti del team di ricerca e sperimentazione didattica Antolini Ettore,Vallorani Andrea e Vitali Chiara nella prosecuzione dell’applicazione delle discipline STEM alla innovativa “didattica aerospaziale” . Questa volta i ragazzi dello Scientifico “E.Medi”, supportati anche dai docenti Braschi Matteo e Staderini Alessandro, hanno predisposto due nuovi esperimenti scientifici rispetto all’esperienza precedente (Infinity1): la sonda “Ísland”, che ha portato a bordo un esperimento per misurare l’incidenza dei raggi UVB e UVC su tratti genomici della spirulina, e la sonda “Helianthus”, che è stata equipaggiata con due speciali capsule contenenti CO2 per sperimentare la possibilità di trasformare l’anidride carbonica in ossigeno in seguito all’urto delle particelle, accelerate dall’energia d’impatto proveniente dai raggi cosmici. Anche il progetto “Infinity 2”, come il suo precursore “Infinity1”, è nato come attività didattica per alunni di scuola superiore: gli obiettivi pertanto sono stati calibrati in modo da favorire la buona riuscita sia dell’attività scientifico-sperimentale che dell’attività formativa e di crescita personale dei discenti, con l’ambizione di far vivere loro un sogno e l’emozione fantastica di vederlo realizzato tra le loro mani. “Infinity2” è stato condotto grazie al sostegno integrato più fondi diversi riservati alla scuola e qui di seguito elencati:

– Monitor ex 440 Transizione ecologica e digitale

– Pon Avviso 22550 del 12/04/2022 – FESR REAC EU – Laboratori green, sostenibili e innovativi per le scuole

– PNRR Piano Scuola 4.0 – Azione 1 – Next generation class – Ambienti di apprendimento innovativi

– PNRR Piano Scuola 4.0 – Azione 2 – Next generation labs – Laboratori per le professioni digitali del futuro

– PNRR Riduzione dei divari territoriali – Azioni di prevenzione e contrasto alla dispersione scolastica

– PNRR Formazione docenti Progetti nazionali per lo sviluppo di modelli innovativi di didattica digitale integrata

La capacità innovativa gestionale con il conseguente impiego creativo delle risorse è stata attenzionata dall’INDIRE (Istituto Nazionale di Documentazione Innovazione e Ricerca) e condivisa nella biblioteca nazionale.

Inoltre è risultata fondamentale la collaborazione di Giovanni Fuggetta e il sostegno della Leonardo s.p.a., attiva nei settori della difesa, dell’aerospazio e della sicurezza, e il patrocinio dell’ASI (Agenzia Spaziale Italiana).

I 36 ragazzi del Liceo Scientifico “Medi” di Montegiorgio hanno lavorato nei laboratori della scuola opportunamente attrezzati con l’acquisto di strumenti e materiali specifici per la preparazione delle sonde: dieci di loro hanno raggiunto l’Islanda per i lanci mentre gli altri hanno continuato a coordinare le attività dalla sede scolastica. “Infinity 2” è stata un’esperienza sperimentale altamente formativa, che ha collocato l’Istituto Scolastico all’avanguardia nel settore nuovissimo della didattica aerospaziale, addirittura: “prima scuola superiore al mondo” secondo le parole dell’astronauta Samantha Cristoforetti pronunciate durante la restituzione dei dati degli esperimenti in ASI durante la notte dei ricercatori il 27 settembre 2024.

Il documento pubblicato nella Biblioteca Nazionale INDIRE è disponibile https://biblioteca.indire.it/content/994/show

Infinity II il saluto di Samantha Cristoforetti

Affrontiamo le questioni

Infinity2 è stata una missione che ha visto impegnati alcuni studenti e i loro docenti ed ha avuto come obiettivo il lancio di palloni aerostatici in Islanda. A ciascun pallone aerostatico è stata agganciata una sonda costruita dagli stessi studenti e dai loro insegnanti, ognuna con un diverso esperimento.

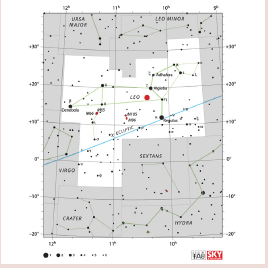

Uno dei lanci ha riguardato l’invio nella stratosfera di una sonda (denominata Ìsland) con agganciate due capsule contenenti alga spirulina (Arthrospira platensis). L’intento è stato quello di misurare, tramite analisi del DNA eseguita prima e dopo il lancio, l’incidenza dei raggi UVB, UVC e cosmici su tratti genomici della spirulina. Nella stessa esperienza, inoltre, si è confrontata anche la capacità di isolamento termico dell’acqua e della CO2.

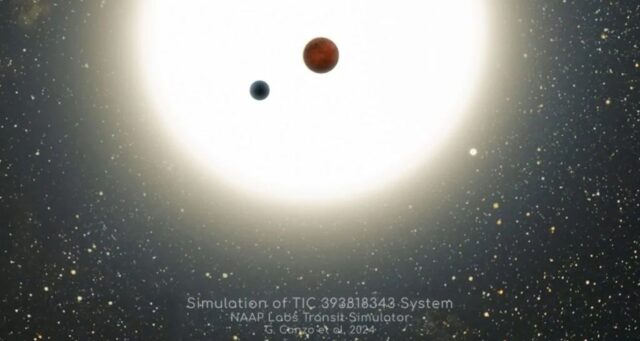

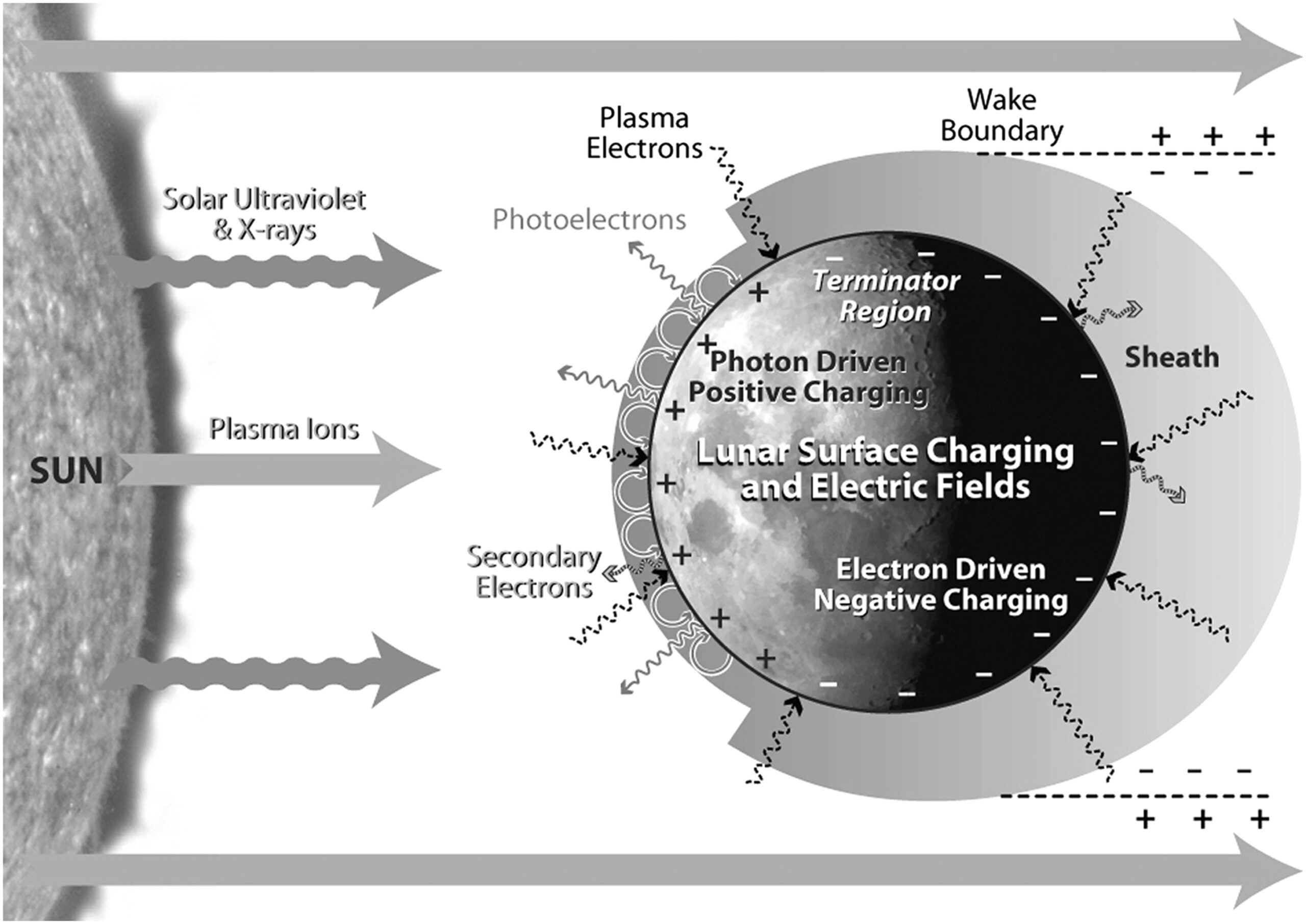

Un altro lancio ha previsto invece di far salire fino alla stratosfera una sonda (denominata Helianthus) con agganciate due capsule in vetro contenenti CO2. L’esperimento mirava a verificare la possibilità di trasformare l’anidride carbonica in ossigeno molecolare a seguito dell’urto delle particelle della stessa CO2 accelerate dall’energia d’impatto proveniente dai raggi cosmici su un catalizzatore in oro.

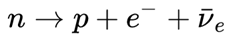

Il meccanismo d’azione ipotizzato consiste nel far sì che i raggi cosmici colpiscano la molecola di anidride carbonica. L’urto con conseguente trasferimento di energia dal raggio cosmico alla molecola di CO2 dovrebbe accelerare la molecola fino a farla urtare contro il catalizzatore in oro con un’energia tale da provocare la separazione del carbonio dall’ossigeno. Tale processo innescherebbe una reazione a catena che dovrebbe portare ad una trasformazione della CO2 in ossigeno molecolare.

Partendo dai risultati dell’esperimento degli scienziati Giapis e Yao del California Institute of Technology (Caltech) in cui sono riusciti a convertire l’anidride carbonica in ossigeno molecolare, si è pensato di utilizzare i raggi cosmici per accelerare la CO2. L’energia necessaria a far acquisire sufficiente energia cinetica da spezzare la molecola di anidride carbonica ed avere la ricombinazione molecolare dell’ossigeno a seguito dell’urto con la lamina d’oro è di almeno 80 eV. L’energia dei raggi cosmici è tra i 108 eV e 1020 eV quindi enormemente superiore.

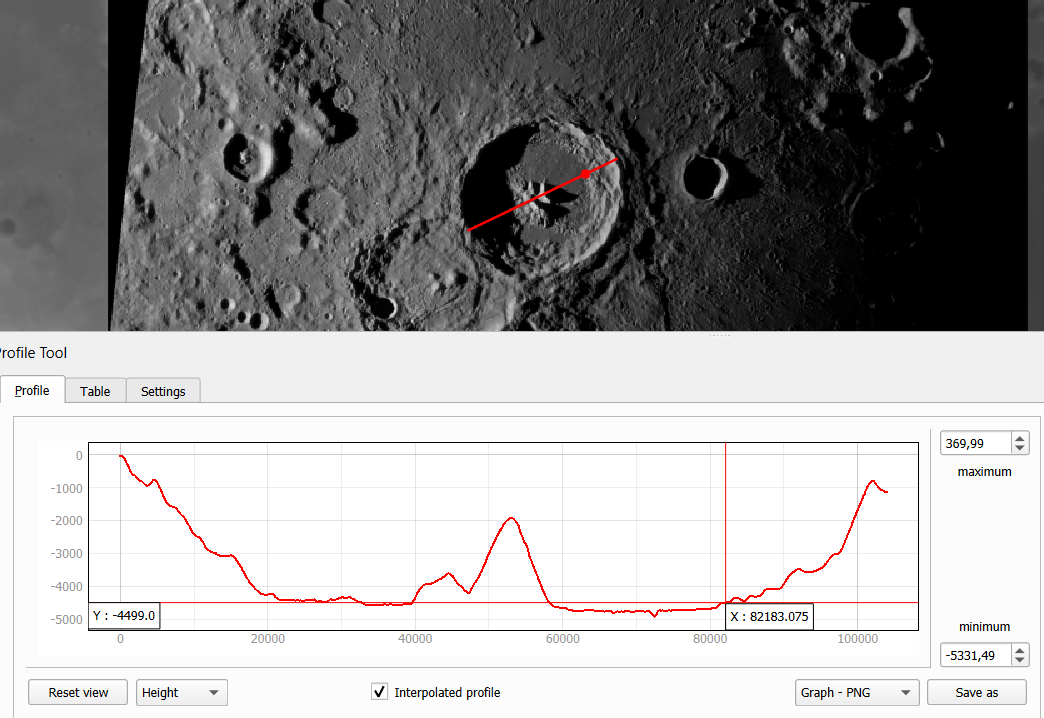

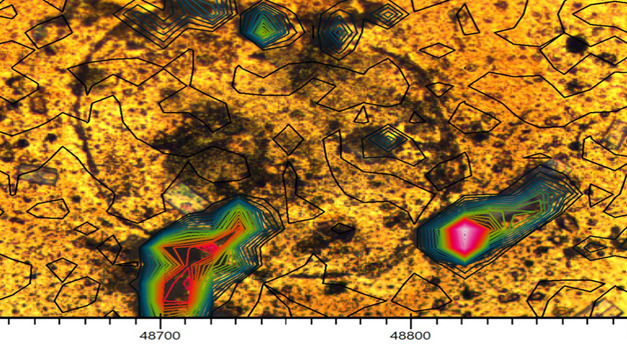

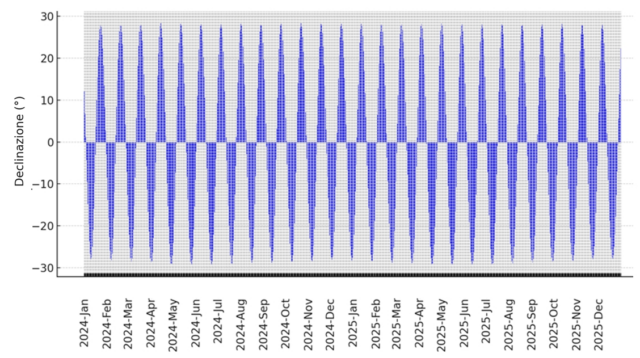

Oltre ai dati in letteratura emersi, la nostra analisi statistica ha confermato la possibilità di intercettare raggi cosmici con un’energia sufficiente ad innescare la reazione di scissione con una probabilità prossima al 100% non appena al di sopra dei 15 Km di quota.

Da letteratura specializzata risulta che il numero di particelle di alta energia almeno 1 GeV che colpisce la superficie di 1 metro quadrato in un secondo è circa 1000 (tra i 15 ed i 40 km di altezza). Nel nostro caso la superficie interessata (lamina d’oro) era di circa 20 cm2.

![]()

La sonda è rimasta esposta ai raggi per circa 115 minuti (6900 s) e la probabilità considerando una distribuzione Poissoniana che venisse colpita da almeno un raggio era praticamente del 100%:

![]()

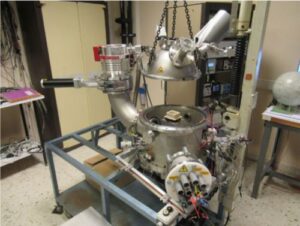

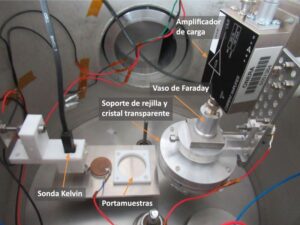

Ad essere colpite dai raggi cosmici sono state delle ampolle in vetro (sistemi di reazione) con all’interno una lamina in oro con la funzione di catalizzatore. Nelle ampolle, provviste di apposito rubinetto di carica/scarica, è stato dapprima fatto il vuoto parziale, e successivamente sono state caricate di anidride carbonica

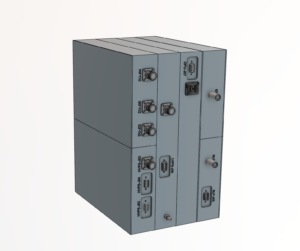

I vettori di lancio utilizzati nei due esperimenti sono stati due sonde completamente progettate e realizzate nei laboratori della scuola. Le sonde sono state abbinate ciascuna ad un vettore di trazione, un pallone aerostatico P2000 con punto di esplosione tra i 39000 e i 41000 m.

ANALISI DEI DATI

l’ARTICOLO COMPLETO è riservato agli abbonati. Per sottoscrivere l’abbonamento Clicca qui. Se sei già abbonato accedi al tuo account dall’Area Riservata

[swpm_protected for=”3″]

L’analisi dei dati è stata condotta in due fasi:

1. Analisi dei gas: dall’analisi gascromatografica dei gas residui è emersa una riduzione del 99,9% della CO2 presente nelle ampolle flight (che sono state nella stratosfera) rispetto a quella blanck (rimasta a terra), cioè la quasi totale scomparsa della CO2.

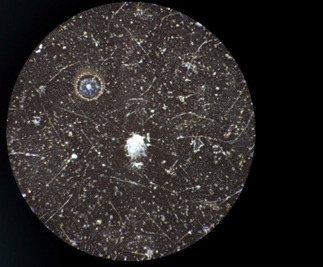

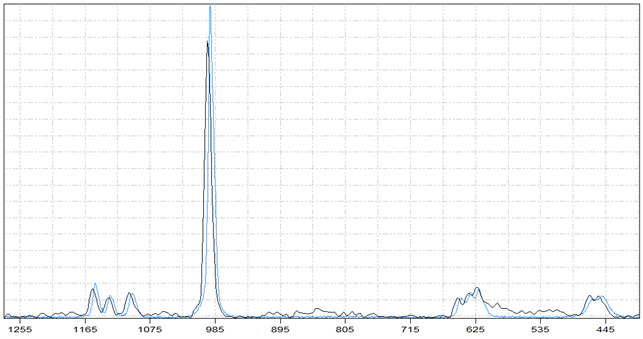

2. Analisi alla spettrometria Raman: dall’analisi Raman (porzione di ampolle flight e blanck analizzata pari a circa 40 micron quadrati, non si è ancora rinvenuto carbonio in forma inorganica (elenco forme sp2).

Tuttavia si è verificata la formazione nell’ampolla flight di una grande quantità di cristalli di metavanadato di sodio. Tale elemento, assente nell’ampolla blanck, ha ∆G e ∆H di formazione entrambi negativi. La sua formazione quindi è stata favorita dalle condizioni di volo.

L’origine della reazione è stata data dal sodio in forma atomica proveniente dalla rottura dei legami del sale di solfato di sodio presenti nel blanck e completamente disgregati nel flight. Ciò significa che l’energia dei raggi cosmici ha provocato la rottura dei cristalli di solfato di sodio (visto che sodio in forma atomica/standard non si è trovato nè nel blanck nè nel flight) energia dell’ordine dei 286 kJ /Kg equivalente a 1,785 x 1024 eV/Kg.

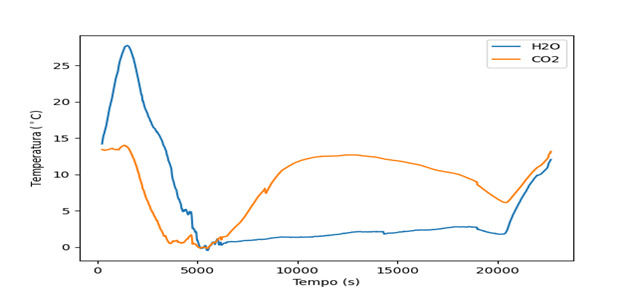

Isolamento termico acqua-anidride carbonica

Dal confronto dei due andamenti nel grafico si è calcolata la differenza di energia tra acqua e anidride carbonica alla quota di 39000 m considerando che la sonda abbia raggiunto la massima quota dopo circa 7120 s di volo tenendo presenti venti in quota, al suolo, latitudine e longitudine, questa differenza è di circa 2,69 gradi. Dalla differenza di temperatura si è passati a determinare quanta energia dovrebbe essere fornita all’acqua per portarla ad isolare tanto quanto la CO2.

Appare evidente che a 39000 m di altezza la CO2 risulta isolare meglio dell’acqua, questo potrebbe aprire nuove prospettive nella realizzazione dell’isolamento (attualmente a base acqua) delle future tute spaziali.

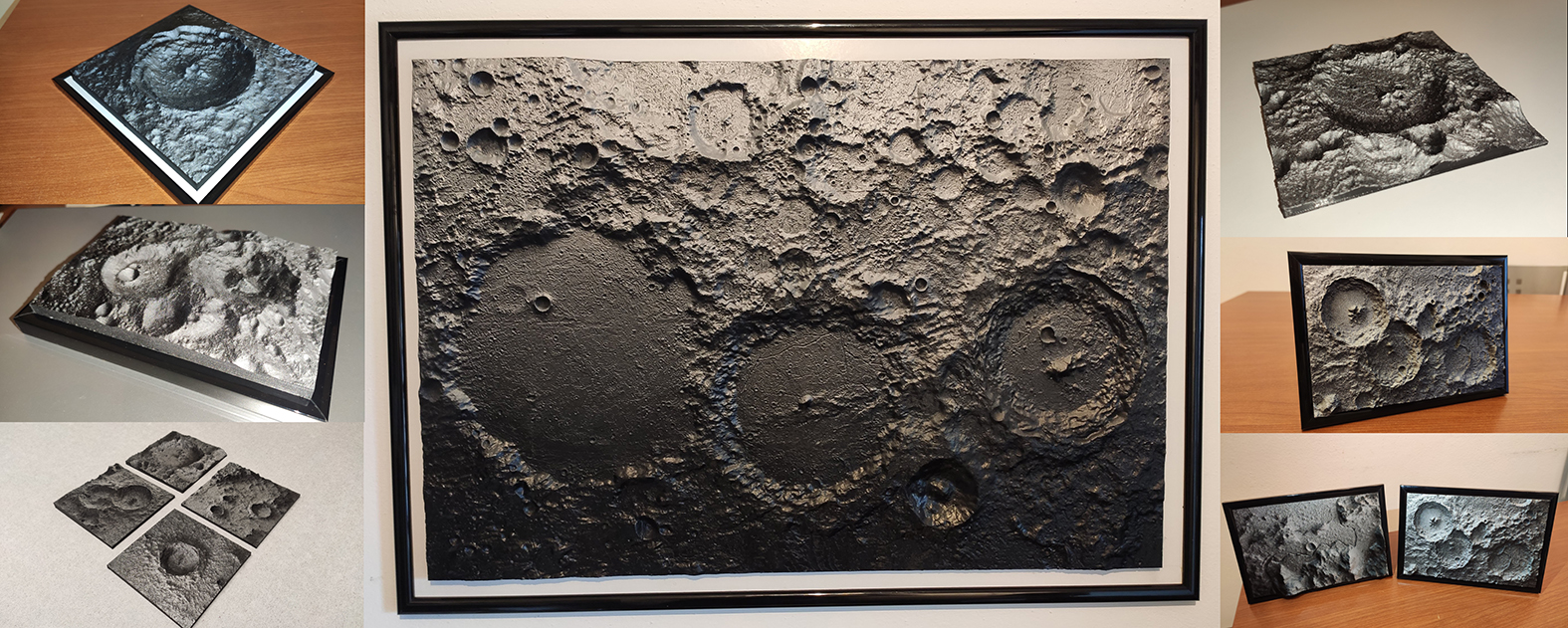

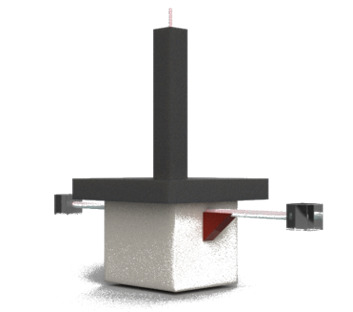

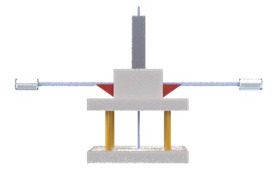

SONDA HELIANTUS

La sonda è stata realizzata con materiali estremamente leggeri (polistirolo e pvc) per poter garantire, sia il rispetto delle norme di sicurezza per il volo, sia la funzionalità del vettore.

Strutturalmente la sonda è stata costruita con due braccia che hanno tenuto esposto per tutto il tempo di volo il sistema di reazione (vedi foto) rappresentato dalle ampolle.

Tali ampolle sono state ideate e progettate dal team della scuola. Hanno forma cilindrica, provviste di rubinetto carica/scarica e sono state realizzate in vetro rubino nel laboratorio di Sesto San Giovanni (MI) di Disa Raffaele. Al loro interno è stata posizionata una lastra di vetro rivestita in oro 24 K. La funzione della lastra colata in oro è quella di fungere da catalizzatore. (O=C=O raggi cosmici ==> O2 + C sp2).

All’interno delle ampolle è stato dapprima fatto il vuoto parziale poi è stata caricata CO2 fino al raggiungimento di una pressione interna pari a -0,196 atm grazie al fondamentale supporto della Nippon Gases di Empoli.

Le ampolle sono state posizionate al momento del lancio con un angolo, rispetto al catalizzatore, di 36° in modo da ottenere la massima incidenza dei raggi cosmici.

L’atteso dell’esperienza è di verificare la scomparsa della CO2 e la comparsa di C in forma inorganica. La verifica dell’aumento dell’ossigeno non è fattibile vista comunque la grande percentuale dell’ossigeno residuale presente in capsula dopo il vuoto parziale.

Le analisi di verifica sono state effettuate in due step:

- gas cromatografia presso il politecnico di Milano

- microscopio elettronico RAMAN CNR Roma

Dalla prima analisi, si è verificata la quasi completa scomparsa della CO2 dalle ampolle in sonda (flight) a differenza dell’ampolla di controllo (blanck).

| Co2 Ampolla flight 1 ppm | Co2 Ampolla flight 2 ppm | Co2 Ampolla blanck ppm | Variazione percentuale Ampolla flight 1 | Variazione percentuale Ampolla flight 2 |

| 2956 | 444 | 351387 | -99,90% | -99,90% |

*Dati Politecnico di Milano

Dalla seconda analisi al Raman (ad oggi effettuata su di una limitatissima porzione pari a 40 micron quadrati) è emersa la presenza nel blanck di numerosi cristalli di Na+2SO4— (solfato di sodio) assenti però nel flight dove compaiono invece numerosi e ben strutturati cristalli di NaVO3 (metavanadato di sodio). Al momento non sono state rinvenute forme di carbonio inorganico (vedi grafico).

CONCLUSIONI

In prima analisi – gas cromatografia – possiamo constatare che la CO2 nelle ampolle flight è scomparsa. La verifica in secondo step – Raman – ha mostrato sia la presenza di contaminanti ma anche dimostrato la fattibilità dell’esperienza.

La fusione del solfato di sodio, con successiva formazione del metavanadato di sodio, sono la prova del fatto che l’energia dei raggi cosmici sia primari che secondari che terziari è sufficiente a rompere legami chimici di molto più forti di quelli presenti nell’anidride carbonica.

La scomparsa dei cristalli di solfato di sodio (deltaf H°= +1383 kjmol-1 pari a 8,6 x 1024 eVmol-1 ) nel flight con relativa sodio formazione dei cristalli di metavanadato di sodio sono la dimostrazione che:

a. i raggi cosmici hanno energia molto elevate da 108 eV fino a 1020 eV

b. i raggi cosmici possono spezzare direttamente legami chimici o colpire particelle accelerandole fino alla rottura.

All’interno delle ampolle sono stati riscontrati anche attesi agenti contaminanti (vedi Vanadio) probabilmente introdotti dalle bombole usate per realizzare il vuoto.

Ciò ci proietta ad una seconda sperimentazione che, per ovviare a problemi di contaminazione, verrà effettuata con l’uso di anidride carbonica marcata in modo da poter dedurre in modo inequivocabile il processo di trasformazione del gas.

Pur essendo stato un “volo” dalla durata limitata, la spirulina è comunque più sensibile alle mutazioni rispetto ad una cellula eucariota data la velocità di moltiplicazione mitotica, pertanto l’assenza di mutazioni (certificata dall’Istituto Zooprofilattico di Fermo), è un risultato da non sottovalutare di come la CO2 possa schermare anche dai raggi cosmici.

I dati di isolamento ed il relativo costo energetico per il mantenimento della temperatura sono inequivocabilmente a vantaggio della CO2 rispetto all’acqua.

La valenza dei risultati ottenuti ha portato alla loro presentazione da parte del team di Infinity2 direttamente all’ASI “Agenzia Spaziale Italiana” il 26 settembre scorso.

[/swpm_protected]

L’articolo è pubblicato in COELUM 271 VERSIONE CARTACEA

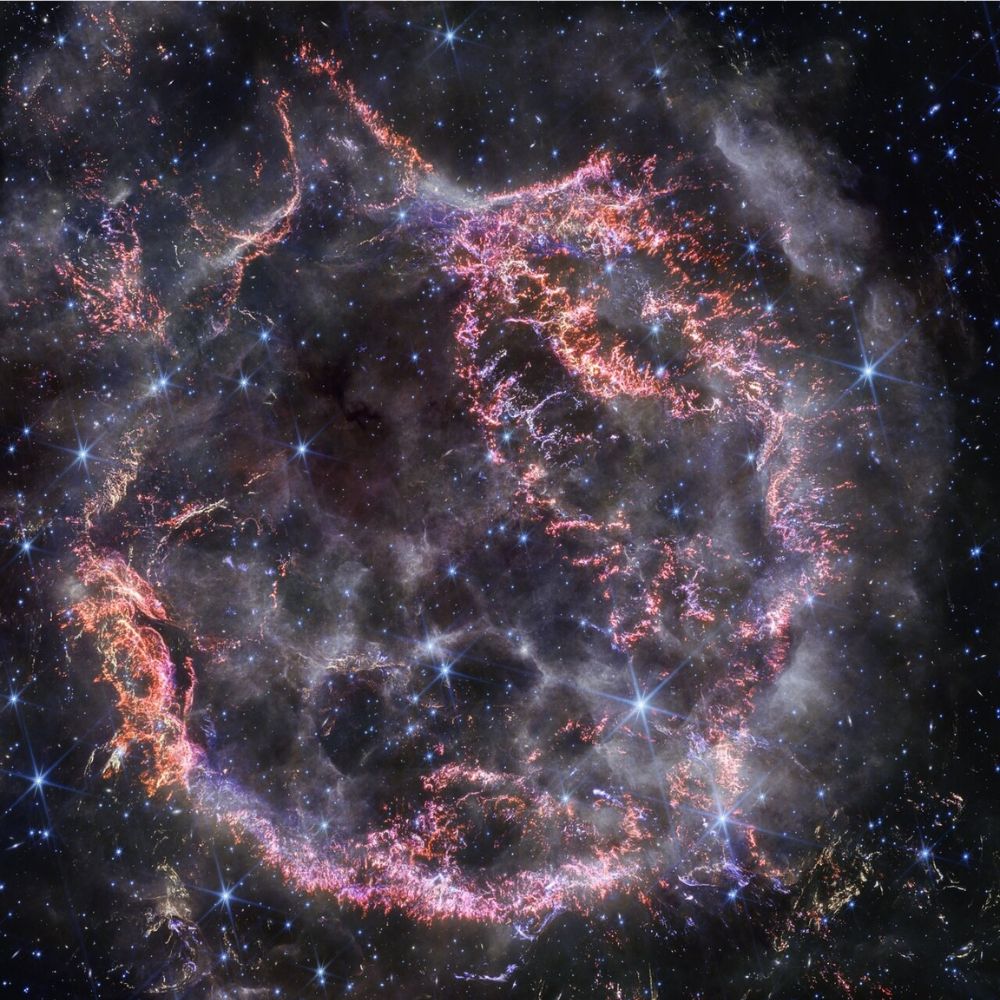

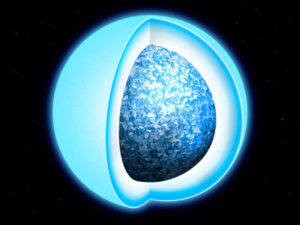

Nane Bianche

Nane Bianche

Nucleo Interno

Nucleo Interno

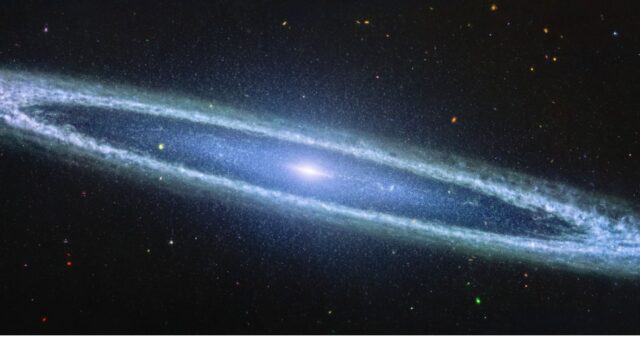

Il centenario di una delle sue scoperte più importanti ci offre l’opportunità di guardare da vicino il lavoro straordinario di Edwin Hubble. I suoi studi rivoluzionarono nel secolo scorso la nostra conoscenza del cosmo al pari di quanto fecero Copernico e Galileo tra 1500 e 1600. Possono la scienza e la tecnica restituirci non solo maggiore conoscenza della realtà che ci circonda, ma anche senso e significato? È buona cosa che qualunque disciplina non risponda a domande che non sono pensate per quella disciplina e che stia, per dirla con parole proprie, nel suo statuto epistemologico. Tuttavia è possibile, se non auspicabile, che le scoperte della scienza ed i traguardi della tecnica, spingano tutti e chiunque a riflettere sul significato della vita e sulle grandi domande umane. Diversamente la scienza e la tecnica rischiano di essere solo a servizio del potere, e rivestite di una presunta neutralità, che non hanno mai avuto davvero, essere concluse in sé stesse. Analoghe considerazioni si possono fare della vita e del modo di fare scienza delle donne e degli uomini che hanno accompagnato l’umanità nel viaggio del sapere, perché le persone e le scoperte che hanno fatto restano sempre un tutt’uno nel fluire della storia. Quando si tratta di esplorazione dello spazio, cielo profondo, fisica ed astrofisica, tutto sembra ancora più favorevole ed invitante.

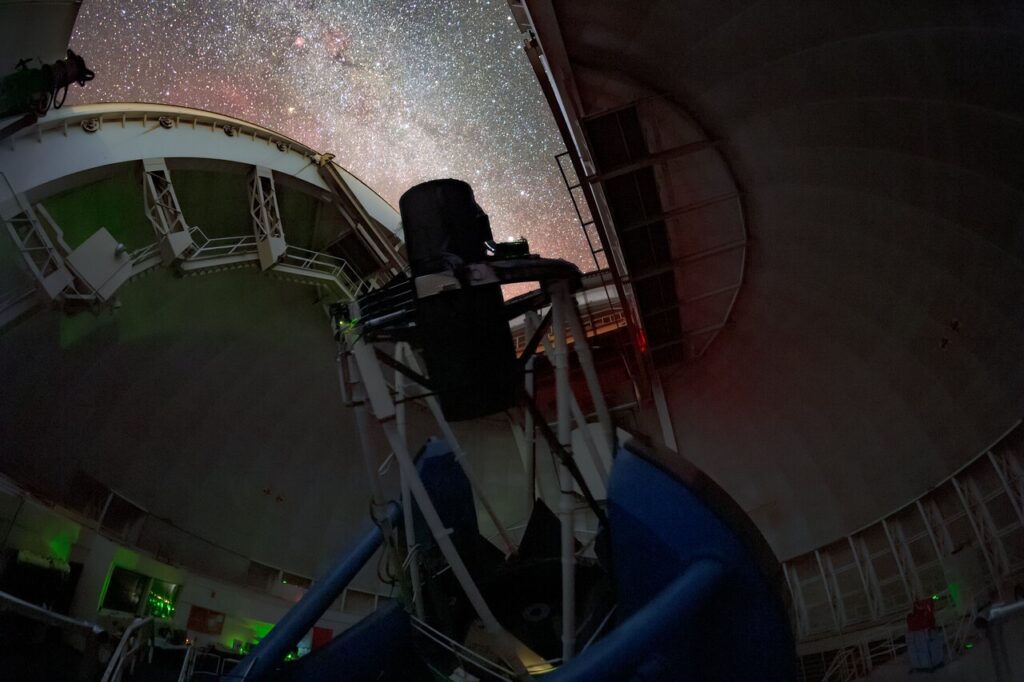

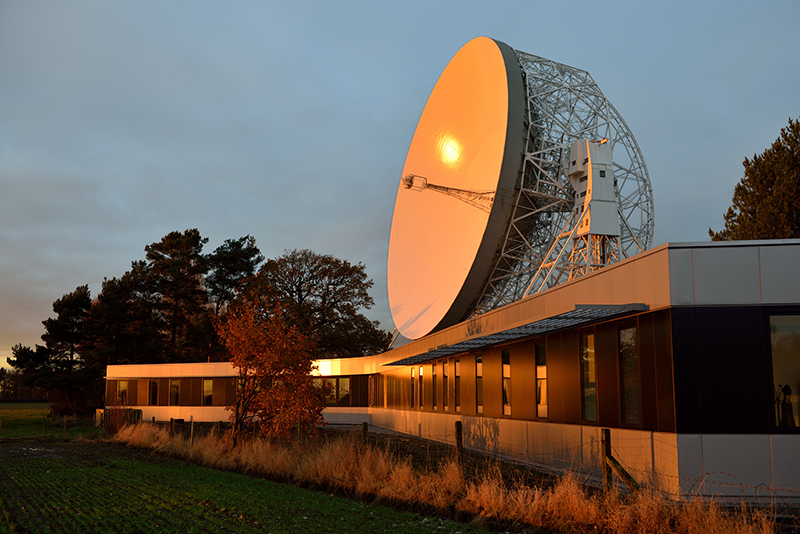

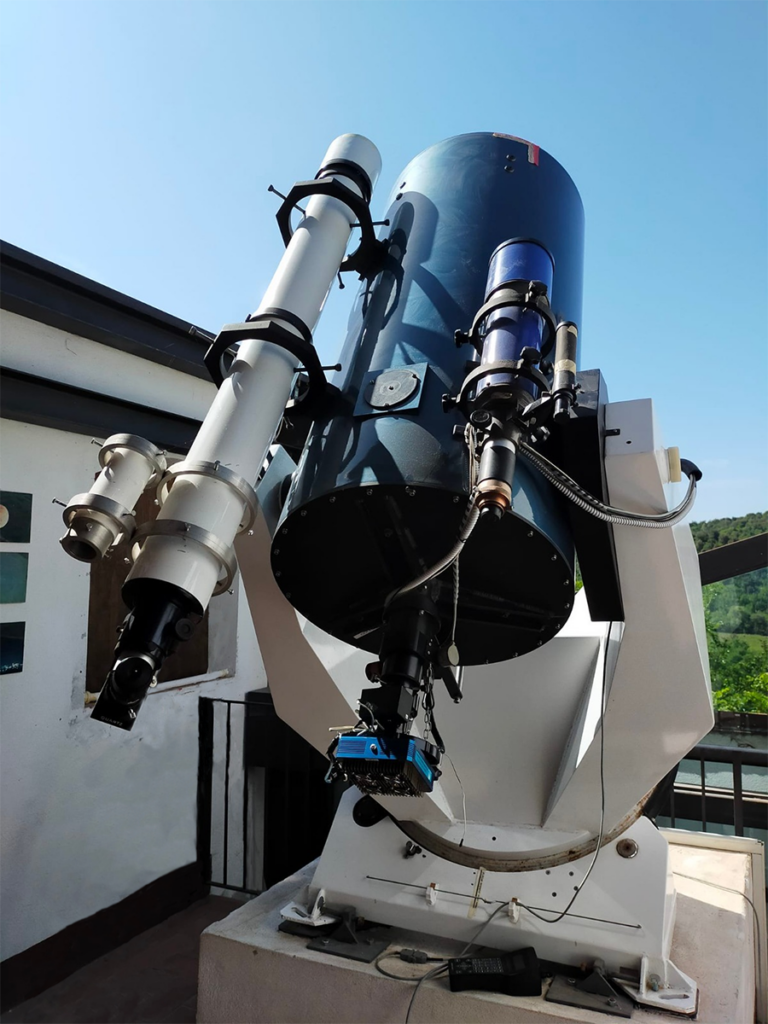

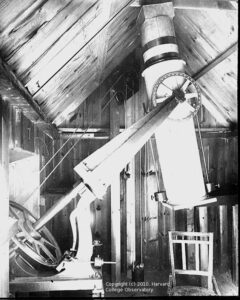

Il centenario di una delle sue scoperte più importanti ci offre l’opportunità di guardare da vicino il lavoro straordinario di Edwin Hubble. I suoi studi rivoluzionarono nel secolo scorso la nostra conoscenza del cosmo al pari di quanto fecero Copernico e Galileo tra 1500 e 1600. Possono la scienza e la tecnica restituirci non solo maggiore conoscenza della realtà che ci circonda, ma anche senso e significato? È buona cosa che qualunque disciplina non risponda a domande che non sono pensate per quella disciplina e che stia, per dirla con parole proprie, nel suo statuto epistemologico. Tuttavia è possibile, se non auspicabile, che le scoperte della scienza ed i traguardi della tecnica, spingano tutti e chiunque a riflettere sul significato della vita e sulle grandi domande umane. Diversamente la scienza e la tecnica rischiano di essere solo a servizio del potere, e rivestite di una presunta neutralità, che non hanno mai avuto davvero, essere concluse in sé stesse. Analoghe considerazioni si possono fare della vita e del modo di fare scienza delle donne e degli uomini che hanno accompagnato l’umanità nel viaggio del sapere, perché le persone e le scoperte che hanno fatto restano sempre un tutt’uno nel fluire della storia. Quando si tratta di esplorazione dello spazio, cielo profondo, fisica ed astrofisica, tutto sembra ancora più favorevole ed invitante. L’astronomo americano nel descrivere la sua scoperta straordinaria sceglie di condividerne gli onori con il suo telescopio ed in modo quasi commuovente. Così scrive nel 1932 in The Realm of the Nebulæ, una raccolta di lezioni tenute nell’ambito delle Silliman Memorial: “Lo strumento che ha definitivamente stabilito l’identificazione e ampliato il dominio della conoscenza concreta di mille milioni di volte è il telescopio Hooker, il riflettore da 100 pollici dell’Osservatorio di Mount Wilson della Carnegie Institution di Washington. È il più grande telescopio in funzione, ha il maggior potere di raccolta della luce e penetra alla massima distanza. Per questi motivi, definisce l’attuale estensione della regione osservabile dello spazio e ha contribuito i dati più significativi allo studio della regione come campione dell’universo. In riconoscimento del ruolo unico che il telescopio da 100 pollici ha svolto nel progresso della ricerca sulle nebulose, le illustrazioni in questo libro sono quasi tutte riproduzioni di fotografie scattate con il grande telescopio”.

L’astronomo americano nel descrivere la sua scoperta straordinaria sceglie di condividerne gli onori con il suo telescopio ed in modo quasi commuovente. Così scrive nel 1932 in The Realm of the Nebulæ, una raccolta di lezioni tenute nell’ambito delle Silliman Memorial: “Lo strumento che ha definitivamente stabilito l’identificazione e ampliato il dominio della conoscenza concreta di mille milioni di volte è il telescopio Hooker, il riflettore da 100 pollici dell’Osservatorio di Mount Wilson della Carnegie Institution di Washington. È il più grande telescopio in funzione, ha il maggior potere di raccolta della luce e penetra alla massima distanza. Per questi motivi, definisce l’attuale estensione della regione osservabile dello spazio e ha contribuito i dati più significativi allo studio della regione come campione dell’universo. In riconoscimento del ruolo unico che il telescopio da 100 pollici ha svolto nel progresso della ricerca sulle nebulose, le illustrazioni in questo libro sono quasi tutte riproduzioni di fotografie scattate con il grande telescopio”.